引言:智能,被过度神话了

人类花了几千年把"智能"供上神坛。亚里士多德说理性是人的本质;笛卡尔说"我思故我在",把意识和肉体截然分开;图灵在 1950 年问"机器能思考吗",那时候这个问题还像个哲学玩笑。

然后,2022 年底,ChatGPT 出现了。

它不是第一个语言模型,但它是第一个让普通人感到"这东西好像真的在理解我"的系统。更让人不安的是:它跑在硅片上,没有神经元,没有进化史,没有童年创伤,没有任何我们以为"智能必须有"的东西——它只是在做一件事:预测下一个词。

这篇文章的目的,不是告诉你 LLM 有多神奇,而是恰恰相反——把它拆开,让你看清楚里面装的是什么。当你看清楚之后,你会发现:它既没有你想象的那么神秘,也没有你以为的那么简单。

第一章:一把尺子量不了意思——从距离到方向

欧氏距离的局限

假设你要比较两篇文章的"相似程度",最直觉的方法是数词频:把每个词出现的次数列成一个向量,然后计算两个向量之间的直线距离(欧氏距离)。

问题来了。一篇 1000 字的文章和一篇 10000 字的文章,即便内容完全相同,词频向量的长度也差了十倍,欧氏距离会很大——但它们明明在说同一件事。这就是长度作弊问题:向量的模长污染了我们对"意思相不相近"的判断。

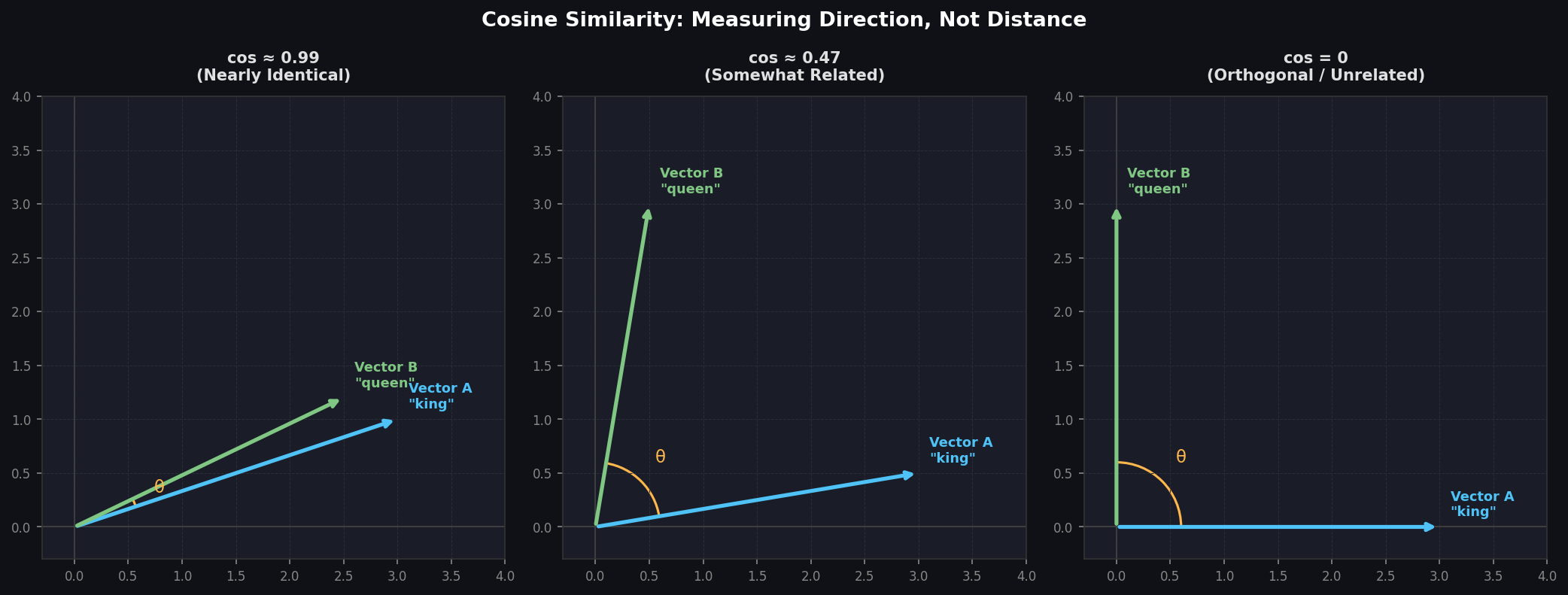

余弦相似度:只看方向

解决方案是余弦相似度。它的公式很简单:

分子是两个向量的点积,分母是两个向量模长的乘积。这个操作的效果是:把长度信息从分子里除掉,只留下方向信息。结果是一个 -1 到 1 之间的数,就是两个向量夹角的余弦值。

这里有一个关键的认知转换:我们不再问"这两个东西离得多远",而是问"这两个东西指向同一个方向吗"。这个转换,是理解整个 Transformer 架构的第一把钥匙。

归一化:把长度抹平

在实际操作中,我们通常会先对向量做归一化(除以自身的模长),把所有向量都变成单位向量——长度统一为 1,只保留方向。归一化防止了高频词("的""是""了")因出现次数极多而在注意力计算中占据不成比例的权重,把真正有语义价值的词压下去。

第二章:词语住在哪里——语义空间的诞生

把语言变成坐标

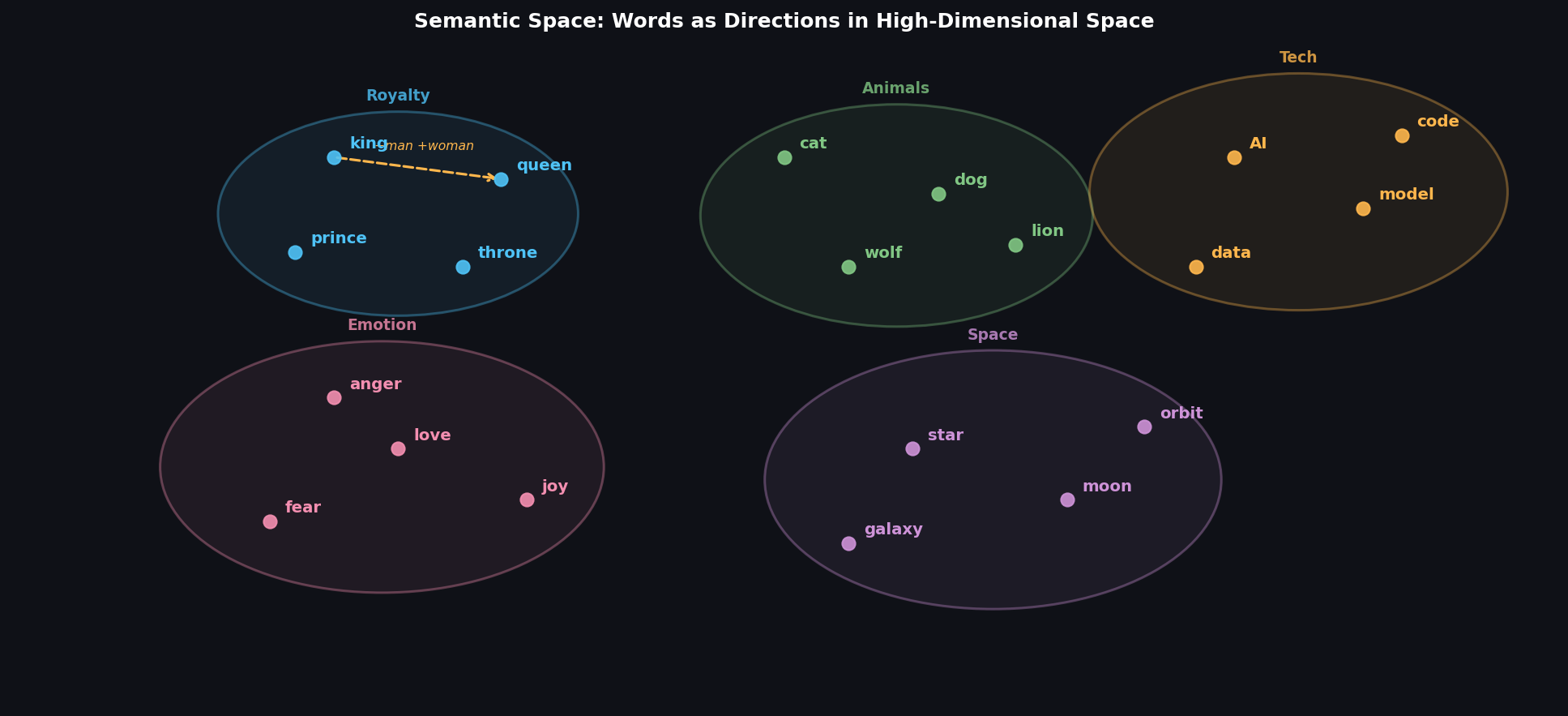

余弦相似度是工具,但要用它,我们首先需要把词语变成向量。2013 年,Google 的研究团队发布了 Word2Vec,给出了一个优雅的答案:让神经网络通过预测上下文来学习词向量。核心思想是"一个词的意思,由它的邻居决定"(distributional hypothesis)。如果"猫"和"狗"总是出现在相似的上下文里,那么它们的向量就应该指向相近的方向。

训练完成后,每个词都对应一个高维空间里的坐标点——通常是 300 维或更高。这个空间就是语义空间(Semantic Space)。

语义空间里的算术

Word2Vec 最令人惊叹的发现是:这个空间里可以做向量算术。

king − man + woman ≈ queen

这不是巧合,而是语义结构在高维空间里的几何体现。"king 和 man 的差"编码了"皇权"这个概念;把这个方向加到"woman"上,就得到了"queen"。高维空间里的"方向"就是"意思"。

| 余弦值范围 | 语义关系 | 示例 |

|---|---|---|

| 0.9 ~ 1.0 | 近义词 / 同一概念 | cat ↔ kitten |

| 0.6 ~ 0.9 | 强相关 | cat ↔ dog |

| 0.3 ~ 0.6 | 弱相关 | cat ↔ animal |

| 0.0 ~ 0.3 | 几乎无关 | cat ↔ democracy |

| < 0 | 反义 / 对立 | hot ↔ cold |

第三章:模型怎么"看"一句话——自注意力机制

语境的问题

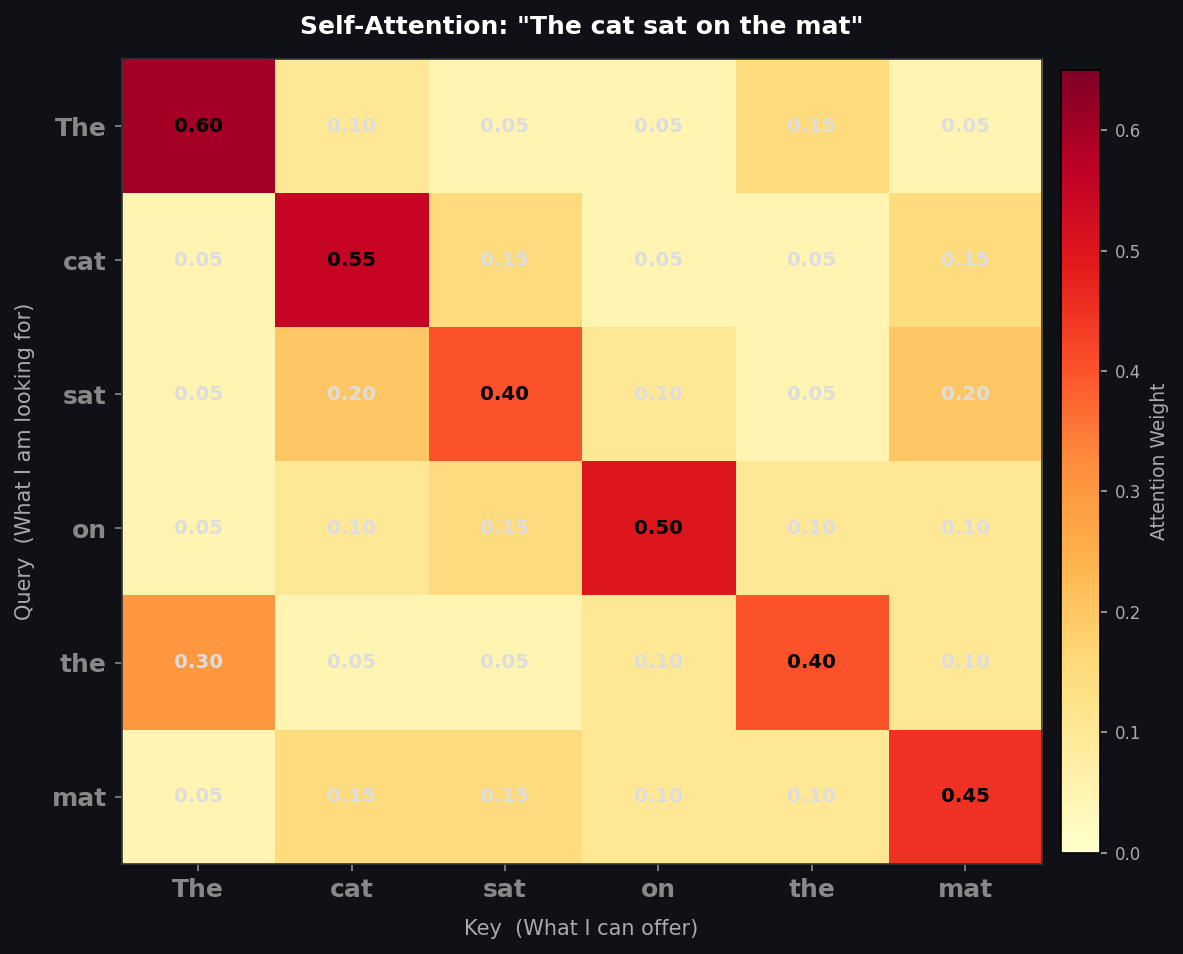

词向量解决了"单个词的意思",但语言的意思从来不是孤立的。"苹果"这个词,在"我吃了一个苹果"和"苹果发布了新 iPhone"里,意思完全不同。模型需要一种机制,让每个词在处理时能"看到"上下文,并根据上下文调整自己的表示。这就是自注意力机制(Self-Attention)要解决的问题。

Q、K、V:三个角色的直觉

自注意力机制引入了三个矩阵变换,把每个词的向量投影成三个不同的角色:

- Query(查询)代表「我现在想找什么」。当模型处理「苹果」时,Query 向量在问:「谁能帮我理解我的语境?」

- Key(键)代表「我能提供什么标签」。每个词都有一个 Key 向量,相当于在说:「我是这样一种信息。」

- Value(值)代表「我真正的内容」。一旦某个词被「选中」(注意力权重高),它的 Value 向量就会被提取出来,贡献给当前词的表示。

注意力分数的计算公式是:

这个公式在做三件事:第一,用 Q 和 K 的点积计算"相关性分数"(本质上就是余弦相似度的变体);第二,除以 √d_k 防止数值爆炸;第三,用 softmax 把分数变成概率分布,再加权求和 V。

为什么要除以 √d_k?当向量维度 d_k 很大时,Q 和 K 的点积值会随维度增大而增大。如果点积值过大,softmax 函数会把绝大部分概率集中到最高分的那个词上,其他词的权重趋近于零,梯度消失,训练崩溃。除以 √d_k 就像给车加了一个限速器:把数值压回到合理范围,让 softmax 能够产生平滑的概率分布,而不是"赢者通吃"。

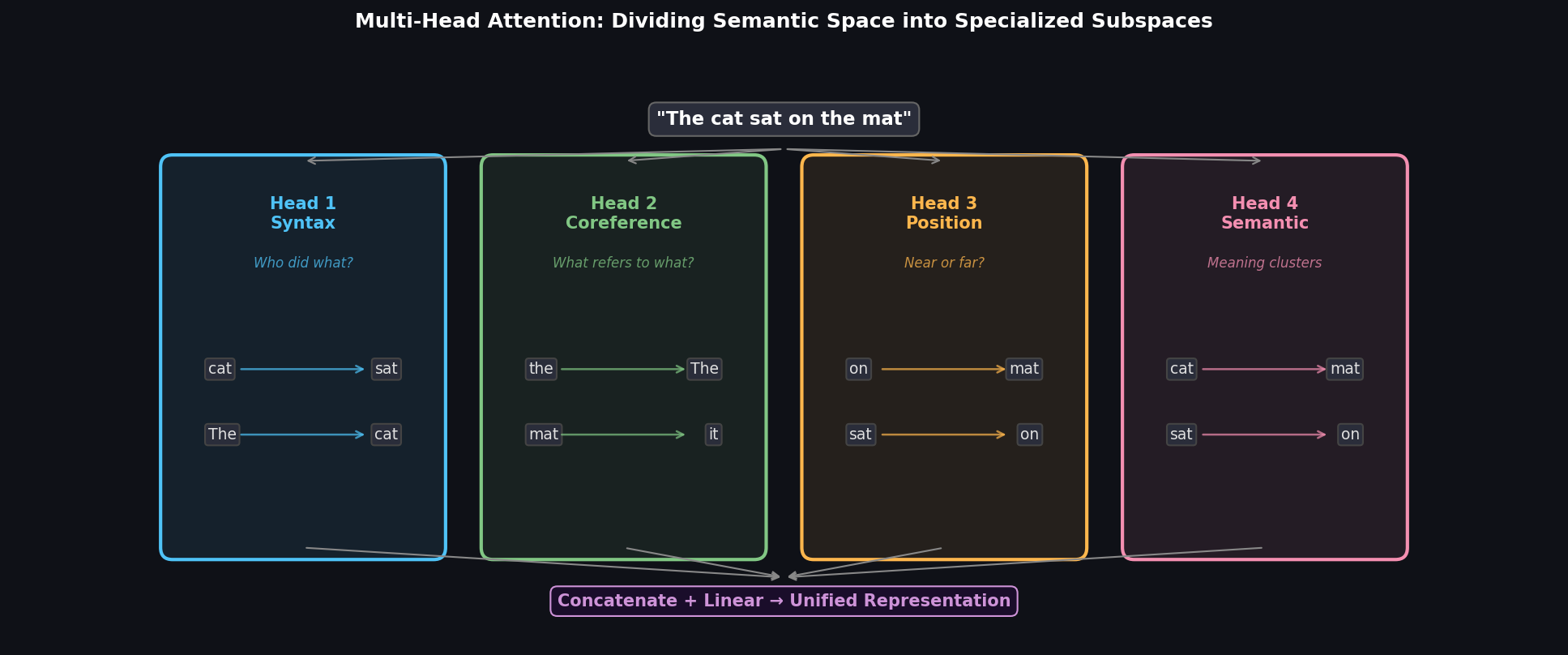

第四章:一个头不够用——多头注意力的分工哲学

单头的困境

自注意力机制很强大,但它有一个根本性的局限:一个注意力头只能同时关注一种关系。想象你在读一篇文章,你需要同时追踪:谁是主语、代词指代谁、哪些词在情感上相关……这些是完全不同类型的关系,用同一套 Q/K/V 矩阵去捕捉所有这些关系,就像让一个人同时盯着棋盘的每一个角落——顾此失彼。

多头:把语义空间切成子空间

多头注意力(Multi-Head Attention)的解决方案非常直接:把语义空间切成多个子空间,每个注意力头在自己的子空间里专注于一种关系。具体做法是:把原始的 d_model 维向量(比如 512 维)分成 h 个头(比如 8 个头),每个头只看 d_model/h = 64 维的子空间。

八个头各自计算完注意力之后,把结果拼接(concatenate)起来,再通过一个线性变换压缩回原始维度。这个线性变换相当于"让八个专家开一个会,把各自的发现整合成一份统一的报告"。

| 参数 | 单头注意力 | 多头注意力(8头) |

|---|---|---|

| 每头维度 d_k | 512 | 64 |

| 点积数值范围 | 大,易爆炸 | 小,稳定 |

| 捕捉关系类型 | 1种(混合) | 8种(分工) |

| 参数量 | 相同 | 相同(分配到各头) |

| 表达能力 | 弱 | 强 |

值得注意的是,多头注意力并没有增加参数量——它只是把同样数量的参数分配到了不同的子空间里,让每个子空间都能专注地学习一种关系模式。这是一种极其高效的归纳偏置(inductive bias)。

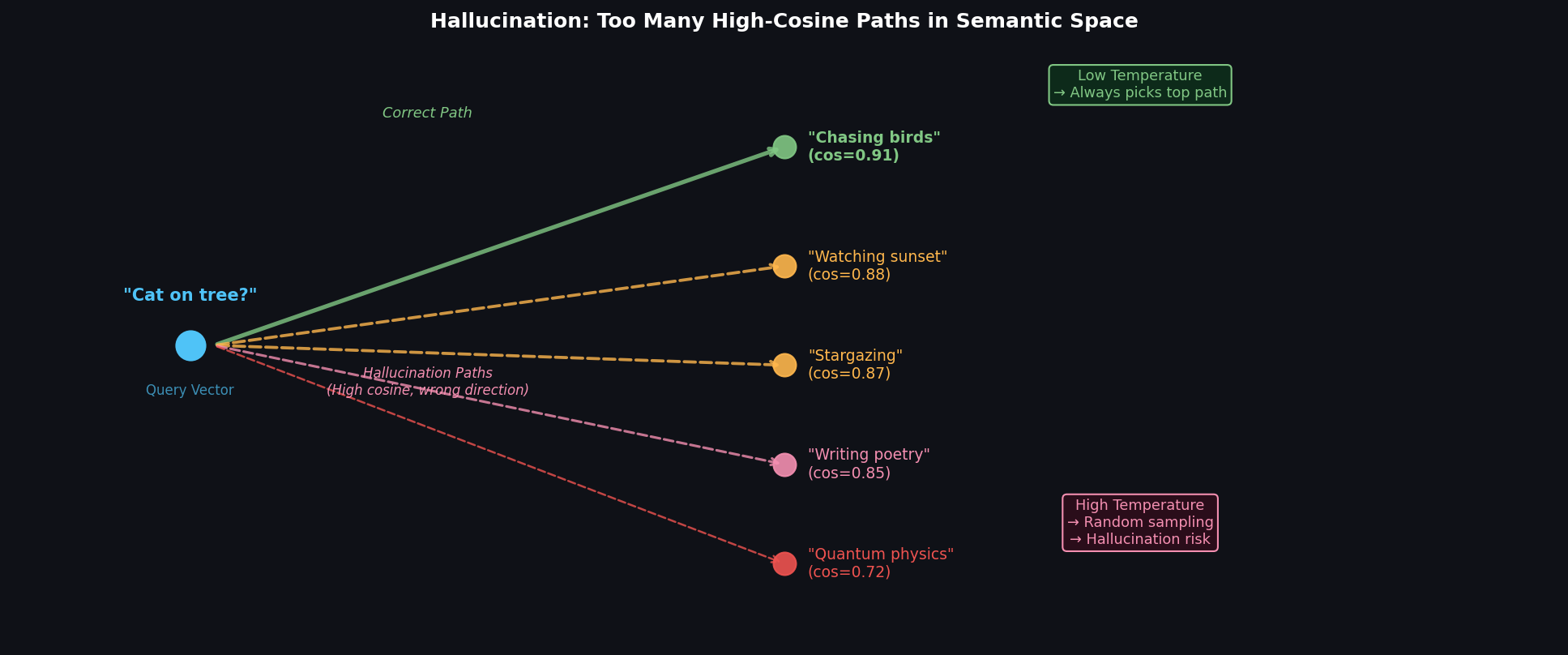

第五章:幻觉从哪里来——高余弦路径的岔路口

语义空间里的"路"

理解了语义空间和注意力机制之后,我们可以用一个更直观的方式来理解语言模型的工作方式:模型在语义空间里走路。给定一个问题,这个问题对应语义空间里的一个向量。模型的任务是找到余弦相似度最高的"答案方向",然后沿着那个方向生成文字。

问题在于:语义空间里,高余弦的路不止一条。

幻觉的本质

幻觉(Hallucination)就是模型在高余弦的岔路口走错了方向。它不是"模型在撒谎",而是"模型在语义上合理但事实上错误的路径上走了下去"。一旦走上错误路径,后续的每一步都会沿着这个方向继续——因为上下文(已经生成的文字)会成为新的 Query,把模型越拉越深。这就是为什么幻觉往往是"一本正经地胡说八道":它在语义空间里是自洽的,只是和现实世界对不上。

解决幻觉的根本方法,是缩小可能路径的子空间。上下文越丰富,约束越多,可能的答案方向就越少,模型就越难走岔。

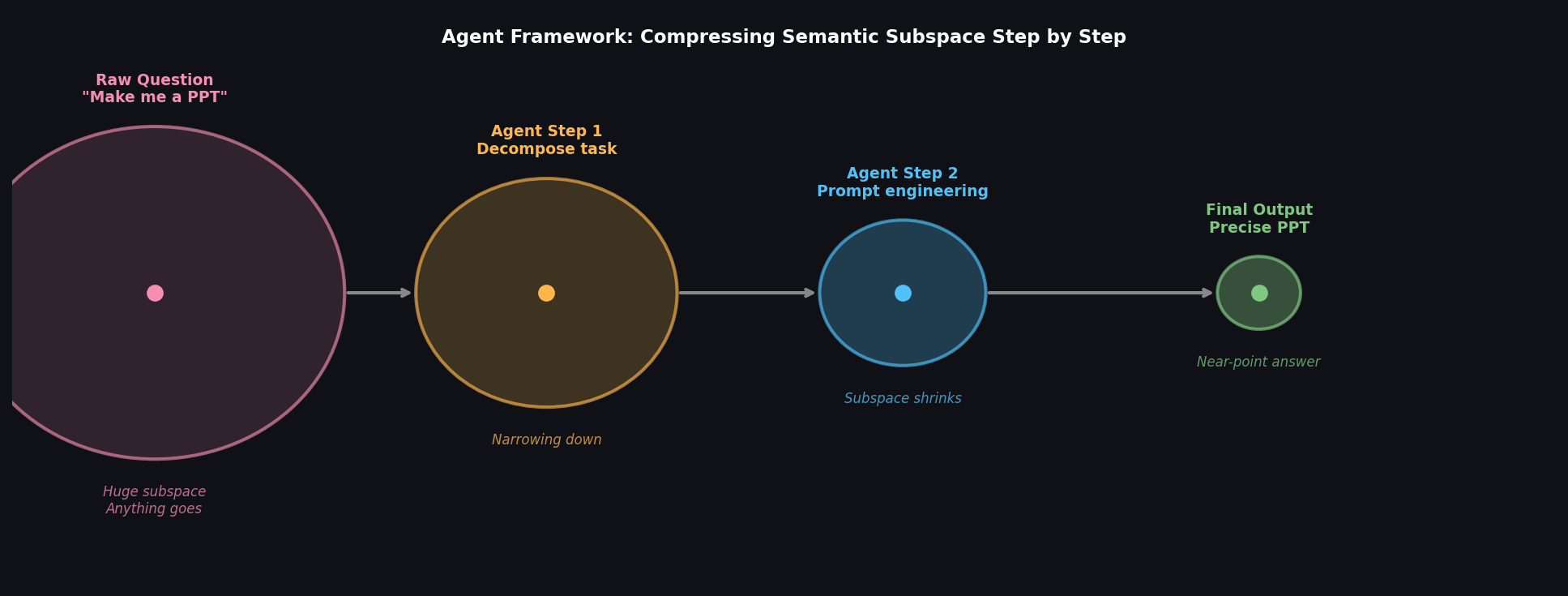

第六章:Agent 框架——把石头磨成箭头

人类语言的局限

人类的语言能力,其实并不擅长精确描述复杂需求。我们说"帮我做个 PPT",这个问题在语义空间里对应一个巨大的子空间——什么主题?几页?什么风格?给谁看?把这个粗糙的问题直接扔给大模型,它只能在这个巨大的子空间里随机游走,输出的结果往往不是你想要的。

Agent:逐步收窄子空间

Agent 框架(如 ReAct、Chain-of-Thought、Manus 等)的本质,是把一个粗糙的大问题拆解成一系列精确的小问题,每一步都在收窄语义子空间,最终把模型逼进一个非常精确的答案区域。

这个过程可以用一个比喻来理解:把石头磨成箭头。原始问题是一块石头——有潜力,但形状模糊;Agent 框架是打磨工具,一刀一刀地削去不需要的可能性,最终留下一个锋利的、精确的答案。提示词工程(Prompt Engineering)的本质也是如此:不是在"教"模型,而是在压缩语义子空间,减少模型可以走的岔路。

终章:智能是物理现象

祛魅的时刻

现在,我们可以回到最开始的问题:智能到底是什么?

在理解了向量、余弦、注意力、多头之后,我们可以给出一个更清醒的答案:大语言模型的"智能",本质上是在做一件事——在一个由数十亿参数构成的高维语义空间里,根据输入向量,找到余弦相似度最高的输出路径,然后沿着这条路走下去。

没有理解,没有意识,没有灵魂。只有矩阵乘法、余弦相似度、softmax 归一化,和海量训练数据压缩出来的统计规律。

但这并不让它变得不重要

这个祛魅的过程,不是在贬低 LLM,而是在重新定位"智能"这个概念。大语言模型的出现打破了"智能是生命专属勋章"这个假设。它告诉我们:智能,可能只是一种信息处理能力。不靠碳基,不靠神经元,只要复杂度够、数据够、算力够,它就能在任何介质里涌现出来。

我们以前把"智能"当成生命专属的勋章,现在发现它更像空气、像重力——谁都能用。

这个认知是解放性的,而不是令人沮丧的。它意味着智能不是稀缺资源,不是某种神秘的生命力,而是一种可以被理解、被工程化、被复制的物理过程。

人类没有那么特殊——但这是好事

人类语言能力的独特性,不在于"只有人类才能处理语言",而在于人类能提出好问题。正如我们在第五章看到的:没有好问题,模型只能在巨大的子空间里随机游走;有了好问题,子空间收窄,答案精确。人类的价值,在于提问的能力——把模糊的需求转化成精确的约束,把巨大的可能性空间收窄到一个有意义的答案。这不是人类的失败,而是人类的专长。

后记:一把余弦尺,量出了什么

我们从一个初中数学概念出发——两个向量夹角的余弦值——走过了语义空间的诞生、自注意力的工作原理、多头注意力的分工哲学、幻觉的几何来源、Agent 框架的本质,最终抵达了"智能是物理现象"这个结论。

这条路走下来,有一个贯穿始终的主题:意义,是方向;理解,是对齐;智能,是在高维空间里找路的能力。

大语言模型找路的方式,和人类大脑找路的方式,可能在底层机制上有着深刻的相似性——不是因为硅片在"模仿"神经元,而是因为信息处理这件事本身,在任何介质里都遵循类似的几何规律。这才是真正让人着迷的地方。

核心概念速查

| 概念 | 数学本质 | 直觉理解 |

|---|---|---|

| 词向量 | 高维空间中的坐标点 | 词语的"地址" |

| 余弦相似度 | cos θ = A·B / (|A||B|) | 两个词"指向同一方向"的程度 |

| 归一化 | 向量除以自身模长 | 抹平长度,只看方向 |

| Query / Key / Value | 三种线性投影 | 问题 / 标签 / 内容 |

| 注意力分数 | softmax(QKᵀ / √d_k) | 每个词对当前词的"相关性权重" |

| 缩放 √d_k | 防止高维点积爆炸 | 给 softmax 加限速器 |

| 多头注意力 | 并行的多个注意力头 | 把语义空间切成子空间,分工协作 |

| 温度参数 | 控制 softmax 的平滑程度 | 调高=抽奖,调低=保守 |

| 幻觉 | 走上高余弦但错误的路径 | 语义上合理,事实上错误 |

| 提示词工程 | 压缩语义子空间 | 减少岔路,逼模型走窄路 |

| 智能(LLM视角) | 高维空间中的路径搜索 | 信息处理能力,不依赖碳基生命 |

参考文献

- [1] Mikolov, T. et al. (2013). "Efficient Estimation of Word Representations in Vector Space." arXiv:1301.3781. arxiv.org/abs/1301.3781

- [2] Vaswani, A. et al. (2017). "Attention Is All You Need." NeurIPS 2017. arxiv.org/abs/1706.03762