具身智能,还是具身技能?

一次正本清源的尝试

机器人领域有一个词被叫错了,而且叫错的方式很有意思——它不是偶然的笔误,而是一种有意为之的概念升格。

一个词的"升格"

"具身智能"(Embodied Intelligence)这个词,在机器人和人工智能领域已经流行了相当一段时间。它听起来很高级,很前沿,很有学术分量。但我越想越觉得,这个词叫错了。

更准确地说,它不是叫错了,而是被刻意叫高了。

在机器人创业圈,有一种普遍的命名冲动:把"技能"说成"智能"。因为"智能"这个词自带光环,它让人联想到意识、推理、创造力,联想到人类引以为傲的那些高级认知能力。而"技能"就显得朴素多了——好像只是一种可以训练出来的、偏低级的操作能力。

这种命名偏好背后,藏着一种根深蒂固的人类自我傲娇:我们潜意识里认为,智能是人类的专属勋章,而技能不过是熟能生巧的产物。

但这个价值判断,本身就是一个错误。技能从来不比智能低级,它只是住在另一个空间里,遵循另一套规律。

智能与技能,住在两个不同的空间里

要理解这个问题,需要先厘清一件事:智能和技能,根本不是同一个维度上的东西。

- 处理语言、逻辑、推理、摘要

- 输入是语言,输出也是语言

- 在高度抽象的符号世界里运算

- 可以跨本体迁移,云端运行

- 处理当前物理状态下的动作序列

- 输入是感知信号,输出是执行器命令

- 需要身体与世界之间的实时闭环

- 与特定本体结构深度绑定

这两个空间,是两套截然不同的表征体系。把它们混为一谈,就像把"能把菜谱背得滚瓜烂熟"和"能做出一桌好菜"画等号一样荒谬。

高尔夫球的隐喻

有一个例子,能把这个道理说得非常清楚。

假设你读了市面上所有关于高尔夫球的书。你知道握杆的标准姿势,你知道挥杆的力学原理,你知道如何根据风向调整落点。在语义空间里,你对高尔夫球的理解已经相当深刻。

然后你走上球场,握起球杆。

你会发现,你指挥不了自己的身体。你知道肩膀应该怎么转,但你的肩膀不听话。你知道重心应该怎么移,但你的脚踝给你的反馈完全不是书上描述的那种感觉。这就是那句话的真实含义——一看就会,一学就废。

语义空间里的知识,无法直接迁移到动作空间。这不是智力问题,而是两个空间之间存在一道根本性的鸿沟。技能的习得,需要身体本身在真实物理世界中反复迭代,而不是在语言里推演。

这道鸿沟,正是当前机器人领域最核心的挑战——而“具身智能”这个命名,恰恰遮蔽了这个挑战的真实性质。

这道鸿沟,其实早就有人命名了。

1988 年,机器人学先驱汉斯·莫拉维克(Hans Moravec)提出了一个名为“莫拉维克悖论”(Moravec's Paradox)的观察:让计算机实现成人层次的智力测试或下棋,只需要相对少的计算能力;但要让它具备一岁小孩的感知和运动能力,却需要巨大的计算资源。

简单说:让机器下象棋很容易,让它拱一个碗却极难。这与我们的直觉完全相反——我们以为“下棋”是高级智力活动,而“拱碗”不过是简单的辅助动作。但对计算机而言,恐怕恰恰相反。

莫拉维克悖论揭示的,正是本文的核心论点:智能和技能是两个不同的空间。语义空间的问题(下棋、推理、语言)和动作空间的问题(拱碗、行走、操作工具),需要完全不同的解决路径。将具身机器人的技能问题包装成“具身智能”问题,恰恰是在用语义空间的思维方式去解决动作空间的问题——这正是莫拉维克悖论指出的陷阱。

语言模型学到的是"语言",不是"世界"

理解这个问题,还需要看清楚大语言模型究竟学到了什么。

一个孩子从小学一年级读到博士毕业,如果他只是在死记硬背,他学到的其实是语言本身——语法规则、词汇搭配、表达习惯——而不一定是语言背后指向的那个真实世界。语言模型的训练,在某种意义上,正是这个过程的极致版本。

这里有一个关键的区分,值得仔细品味:"正确地说话"和"说正确的话",是两件完全不同的事情。

"正确地说话",只需要符合语言本身的习惯和语法,只需要在语言空间内部自洽。一个在语言空间里高度自洽的系统,甚至可以把幻觉(hallucination)也说得头头是道、逻辑严密。而"说正确的话",则需要语言的输出与物理世界、与真实认知对齐——这是一个更高的要求,也是语言模型至今难以完全做到的事。

技能领域根本不存在幻觉的容忍空间。一个护理机器人如果在动作执行上产生"幻觉",它可能把开水倒在病人手上。一个手术辅助机器人如果在动作空间里"幻觉"了一下,它可能拔掉氧气管。错误的语言输出可以被纠正,但错误的动作执行造成的是不可逆的物理伤害。

这个对比,深刻揭示了智能与技能在评价标准和容错机制上的根本差异。我们对一个语言系统的容忍度,和我们对一个执行系统的容忍度,必须是完全不同的量级。

"具身"这个词,其实更适合技能

"Embodied"这个词,字面意思是"嵌入身体之中"(in-body)。这个词的核心含义,是与本体结构的强绑定,而不仅仅是"与物理世界互动"。

从这个角度来看,智能其实并不需要"具身"。智能可以放在云端,可以运行在任何计算载体上,可以跨本体共享。同一个大语言模型,可以同时服务于手机、电脑、机器人和汽车,它不依赖于任何特定的物理身体。智能,本质上是可以跨本体迁移的。

但技能,恰恰是本体依赖的。技能是嵌入在特定身体结构中的,它与身体的传感器布局、关节自由度、肌肉力矩分布紧密耦合。你在这个身体上训练出来的技能,换一个身体,就很可能失效。

两个例子可以说明这一点。泰国古典舞蹈演员的身体,与普通人的身体在关节活动范围和肌肉训练模式上存在显著差异,一个泰国舞蹈演员在自己身体上习得的那套精妙技能,并不能简单地"下载"到另一个普通人的身体上去执行。而特斯拉的 FSD 系统同样如此:Model 3 和 Cybertruck 的摄像头位置、车身尺寸、转向结构都不同,同一套训练好的模型并不能无缝迁移到不同车型上——每个车型都需要针对自身的本体结构重新适配。

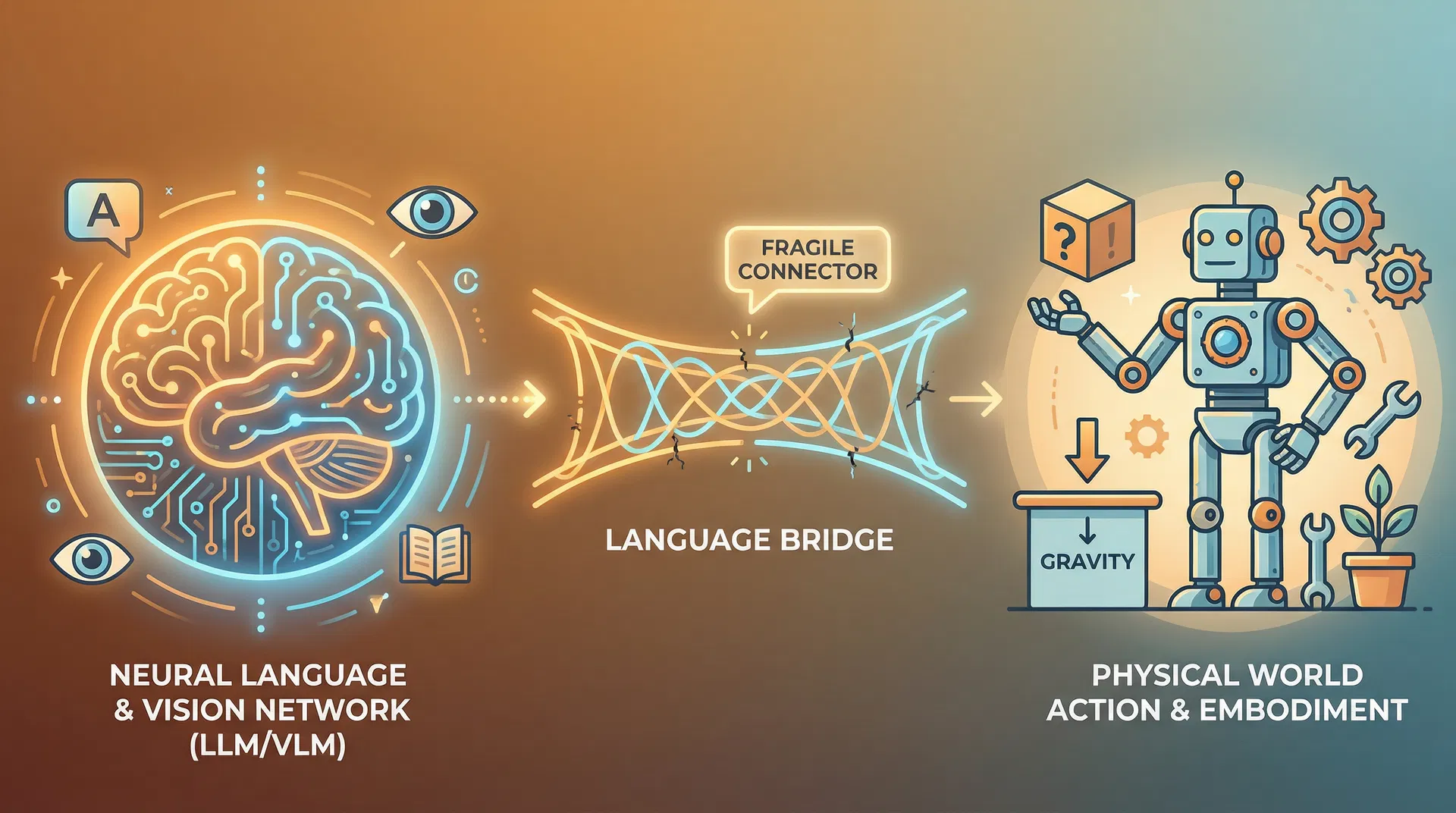

Scaling Law 的诱惑,与一条南辕北辙的路

当前机器人领域有一股强烈的冲动,想要把大语言模型的成功路径复制过来。逻辑链条大致是:LLM 成功了 → 加上视觉变成多模态 → 再加上动作输出变成 VLA(Vision-Language-Action Model)→ 机器人就会了。这个路径的诱人之处在于,它试图用同一套 Scaling Law 的逻辑,把语言、视觉、动作统一到一个框架里。

但这里有一个根本性的问题:语义空间和动作空间,真的是可以互通的吗?

如果它们是互通的,那么人类只需要读完一本详尽的驾驶教材,就应该能开车。只需要看完一套打高尔夫球的视频教程,就应该能打出标准的挥杆动作。但显然,事实并非如此。语言可以描述动作,但语言本身无法成为动作。在语义空间和动作空间之间,硬塞一个 Language 层(即 VLA 中的 L),在很多情况下是一个牵强附会的过渡,而不是真正的桥梁。

更有意思的是,人类的技能学习,本身就不完全依赖模仿。左撇子的存在就是一个反例——父母大多数是右撇子,按照模仿学习的逻辑,左撇子不应该大量出现。而那些后天失去手臂的人,经过一段时间的适应,有些人能用脚和腿完成吃饭、穿衣等精细动作——他们从哪里"模仿学习"这些技能?他们的身体,在没有语言指导、没有模仿对象的情况下,自主地在动作空间里找到了新的解。

还有一个更根本的差异,常常被忽视:语言模型的训练数据,是人类几千年积累下来的现成资产——文字、书籍、网页、印刷品,这些数据已经存在于世界上,可以直接抓取和使用。但具身技能的训练数据,必须重新创造。你需要让机器人在真实的物理世界中反复操作,才能采集到有效的动作数据。这不是一个简单的数据规模问题,而是数据的性质就完全不同——它的采集成本、采集方式、数据结构,与语言数据有着本质的差异。

| 维度 | 语言模型(LLM) | 具身技能 |

|---|---|---|

| 训练数据来源 | 人类几千年的现成文字资产 | 必须在物理世界中实时采集 |

| 数据采集成本 | 低(抓取即可) | 极高(需要机器人反复操作) |

| 错误容忍度 | 可以被人类审计和纠正 | 错误即不可逆的物理伤害 |

| 跨本体迁移 | 可以(同一模型服务多设备) | 困难(与特定身体结构绑定) |

| Scaling Law 适用性 | 高度适用 | 存疑,可能南辕北辙 |

把这一切放在一起,就能看清楚当前"具身智能"行业的一个深层困境:大量公司正在用 Scaling Law 那套方法——堆数据、堆参数、堆算力——来训练机器人,本质上是在用投资人的钱复制语言模型的路径。但如果我们把"具身智能"正名为"具身技能",就会发现:在具身技能的世界里继续用 Scaling Law 的方法,是南辕北辙。

那么,这个领域应该叫什么?

如果从"与物理世界连接"这个角度来定义,Physical AI 这个叫法其实更准确,也更诚实。它直接说明了这类系统的核心诉求:让 AI 能够感知和操作物理世界。

但如果要从"嵌入本体"这个角度给出一个更精确的命名,我认为应该叫具身技能(Embodied Skill)。

因为真正让机器人与物理世界交互起来,需要解决的核心问题,是技能问题:如何让一个特定本体结构的系统,在动作空间里学会完成各种复杂任务的动作序列。这个问题,不是靠在语义空间里堆更多知识能解决的。

"具身智能"这个词,把一个技能问题包装成了智能问题,把一个动作空间的挑战包装成了语义空间的挑战。这不只是命名上的不准确,它还会误导研究方向——让人以为,只要语言模型足够强大,机器人的问题就自然解决了。

而现实是,动作空间有它自己的规律,它需要自己的方法论,需要在本体结构的约束下,在真实物理世界的反馈中,踏踏实实地去学。至于那套方法论究竟是什么,我没有现成的答案——但我至少确信,它不是 Scaling Law。

结语

技能,从来不比智能低级。只是它住在另一个空间里,遵循另一套规律,需要另一套方法去习得。

把技能叫成智能,是一种傲慢——对技能的傲慢,也是对这个领域真实挑战的傲慢。

正本清源,从叫对这个词开始。

本文观点源于一次关于具身智能与具身技能之辨的口述思考,整理成文。

専注于具身智能、AI Agent 与技术文化的深度思考。全世萝卜(Panbotica)创始人,致力于探索人形机器人与智能应用的边界。