刚刚肝完了长达七小时的谢赛宁马拉松式访谈。在当下这个被大语言模型(LLM)的狂热叙事所统治的时代,这场对话就像是在缺氧的密闭空间里砸开了一扇窗——凛冽的冷空气灌进来,让人瞬间清醒。

这场访谈发生在2026年2月的纽约。布鲁克林刚下过一场多年未见的暴雪,一栋略显凌乱的楼房里,对话从下午两点一直延续到凌晨。对话的另一端,是这位出生于1990年的华人科学家——谢赛宁,上海交通大学与加州大学圣地亚哥分校的毕业生,现任纽约大学教授,前 Google DeepMind 与 Meta FAIR 研究科学家,论文引用数近十万次,Diffusion Transformer(DiT)架构的共同提出者。值得一提的是,这是他第一次公开接受访谈。

整场访谈中最让我深受触动的,并非那些晦涩的技术细节,而是 AMI Labs 的伟大使命,以及一群真正的科学家在创业与研究的缝隙里,毅然选择离别"LLM功利场"的英雄气概。

一、逃出硅谷:一次真正意义上的"叛逃"

如今的硅谷大厂和许多明星初创公司,已经深深陷入了 LLM 打榜与商业竞争的"有限游戏"中。庞大的资源被投入到既定的产品周期里,纯粹的前沿研究空间被极度压缩,研究人员甚至失去了"定义问题"的能力——他们只能在别人划定的跑道上拼命奔跑,却无权停下来问一句:这条跑道,究竟通向哪里?

"Silicon Valley is very LLM-pilled。硅谷已经深陷于LLM,完全被它催眠了。"

—— 谢赛宁,2026年2月访谈

这句话的分量,远不止于一句批评。它来自一个在 Meta FAIR 深耕四年、在 Google DeepMind 历练过的人,一个亲历了这场"催眠"全过程的内部人。他看到了什么,才会用"催眠"这个词?

在这样的背景下,谢赛宁与图灵奖得主杨立昆(Yann LeCun)共同创立 AMI Labs(Advanced Machine Intelligence Labs),并不是为了在 LLM 的红海里分一杯羹,而是致力于打造真正的"世界模型"底座。他们试图建立一个"反向 OpenAI"的草根联盟,去关注那些在硅谷叙事中隐形的真实物理世界的需求。这家公司仅有 25 人,没有任何产品,却在 2026 年 3 月完成了 10.3 亿美元的种子轮融资,投前估值高达 35 亿美元。这不仅是对 AI 发展路线的重新纠偏,更是一种真正的科学理想主义的回归。

二、谢赛宁的三重清醒

在访谈中,谢赛宁对当前 AI 范式提出了极其清醒的审视。他的核心观点彼此递进,共同构成了一幅关于"LLM 局限性"的完整图景。

第一重清醒:大语言模型并非通往通用智能的基石

谢赛宁一针见血地指出,LLM 本质上是一种"虚拟智能(Virtual Intelligence)"。它在数字化空间里极度强大——它能写代码、能做诗、能回答几乎任何以文字形式提出的问题——但它缺乏对真实物理世界的感知与交互能力。

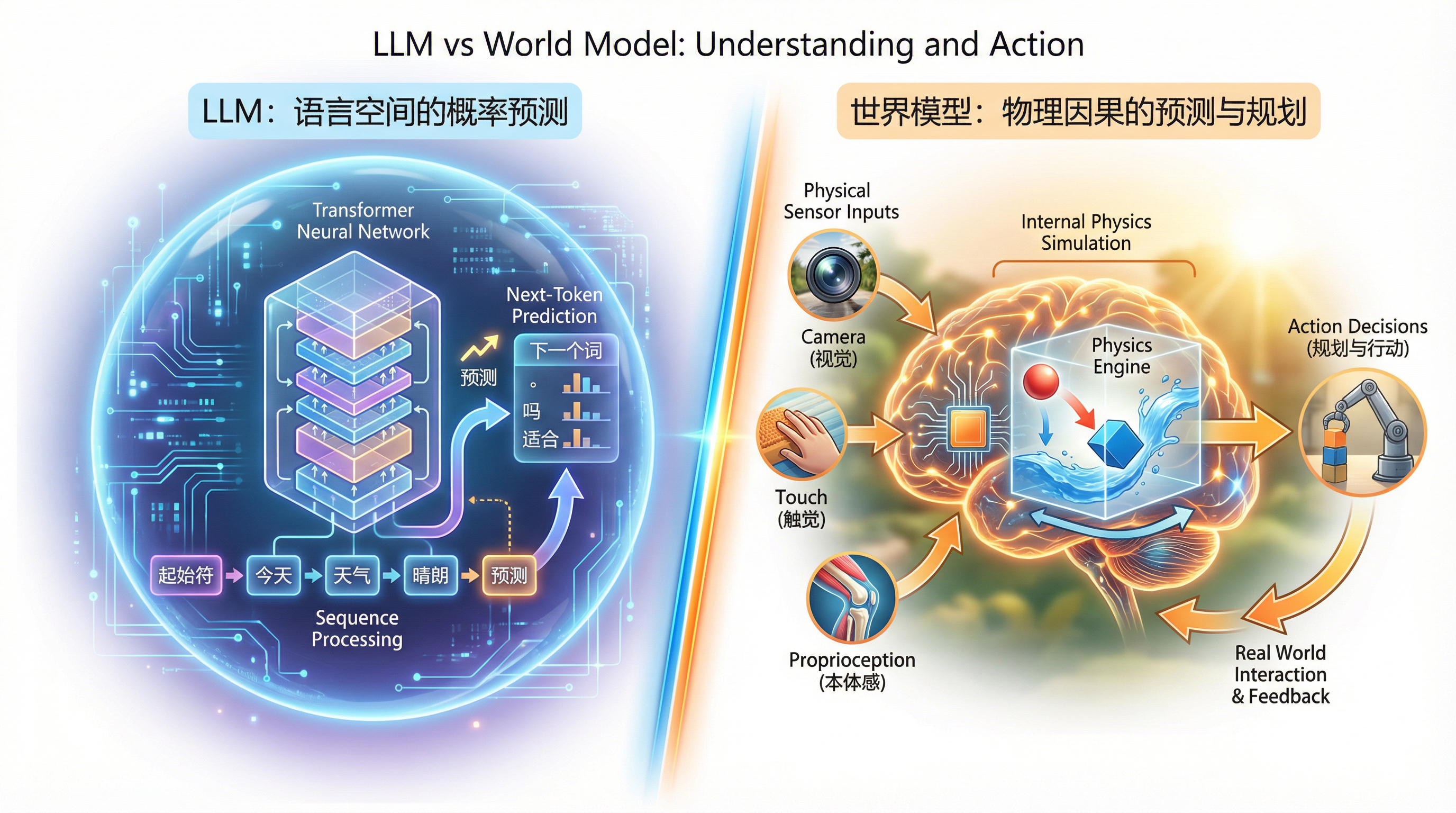

这里有一个关键的概念需要厘清:什么是"世界模型"?谢赛宁给出了一个简洁而深刻的定义——给定一个系统的当前状态和一个干预动作,能够预测下一个状态的后果,从而指导智能体做出决策。这是人类大脑的基本运作方式:我们在脑中模拟"如果我这样做,会发生什么",然后再决定是否行动。

而 LLM 恰恰缺乏这种能力。它没有真实的动作(Action)概念,也无法进行真实的物理规划。它所有的"推理",都是在 Token 的概率分布空间里完成的,而非在物理因果的现实世界里展开的。用 LLM 来做通用智能的底座,就像是用一根拐杖去参加奥运会百米赛跑——它能帮你站立,但绝不可能带你冲刺。

第二重清醒:比特落差——感知、语言与世界模型的"过滤"本质

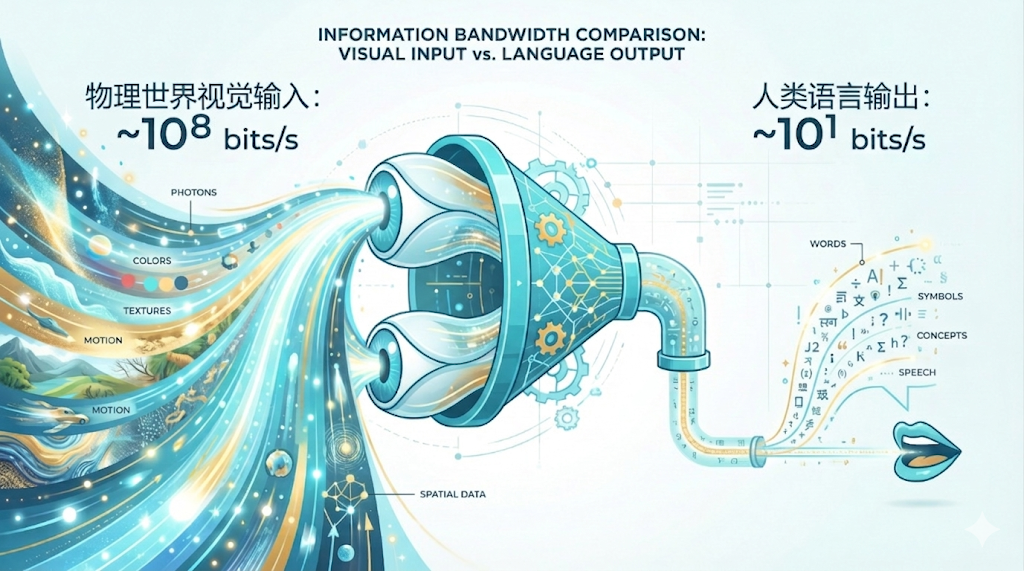

为什么语言不能代表真实世界?谢赛宁提出了一个极具震撼力的"带宽对比",这是整场访谈中最具原创性的洞见之一:

| 信息通道 | 带宽量级 |

|---|---|

| 物理世界输入人类视觉感官 | 每秒约 1 亿~10 亿比特(量级:10 的 8 次方 bits/s) |

| 人类使用语言进行交流 | 每秒约 10~100 比特(量级:10 的 1 次方 bits/s) |

这就引出了大脑(即天然的世界模型)的核心本质——过滤。大脑在极低的功耗下,从海量、连续、高维、嘈杂的物理信号中,过滤掉无用的冗余信息,提炼出极低带宽的行为决策。这套"过滤机制"是智能的真正核心,而语言,只是这套系统最终输出的极度压缩的产物,而不是智能系统思考和运转的本源。

换言之,我们不是因为有了语言才能思考,而是因为有了世界模型才能思考,语言不过是思考结果的一种低带宽编码输出。把语言当作智能的基础,是把输出端的"排气管"误认成了发动机本身。

第三重清醒:大语言模型终将退化为沟通接口

"老兵不死,终将凋零。"谢赛宁预言,在未来的通用智能架构中,大语言模型不会消失,但它将不再是绝对的运算核心。

这是一个关于"降级"的预言,而非"消亡"的预言。当底层建立起了一个能够深刻理解物理世界、掌握最优表征的"世界模型"后,LLM 将退化为这个庞大底座最外层的一个"沟通界面(Communication Interface)"。它的本职工作仅仅是作为"解码器",负责人类与机器之间的意图沟通与信息交互。

这个预言的逻辑是自洽的:既然语言本就是物理世界的低带宽压缩编码,那么在一个真正理解物理世界的系统中,语言处理自然只是最末端的一个"翻译层",而非核心计算层。LLM 的命运,是从"主角"退场为"翻译官"。

三、语言是一套非对称加密系统——我的延伸思考

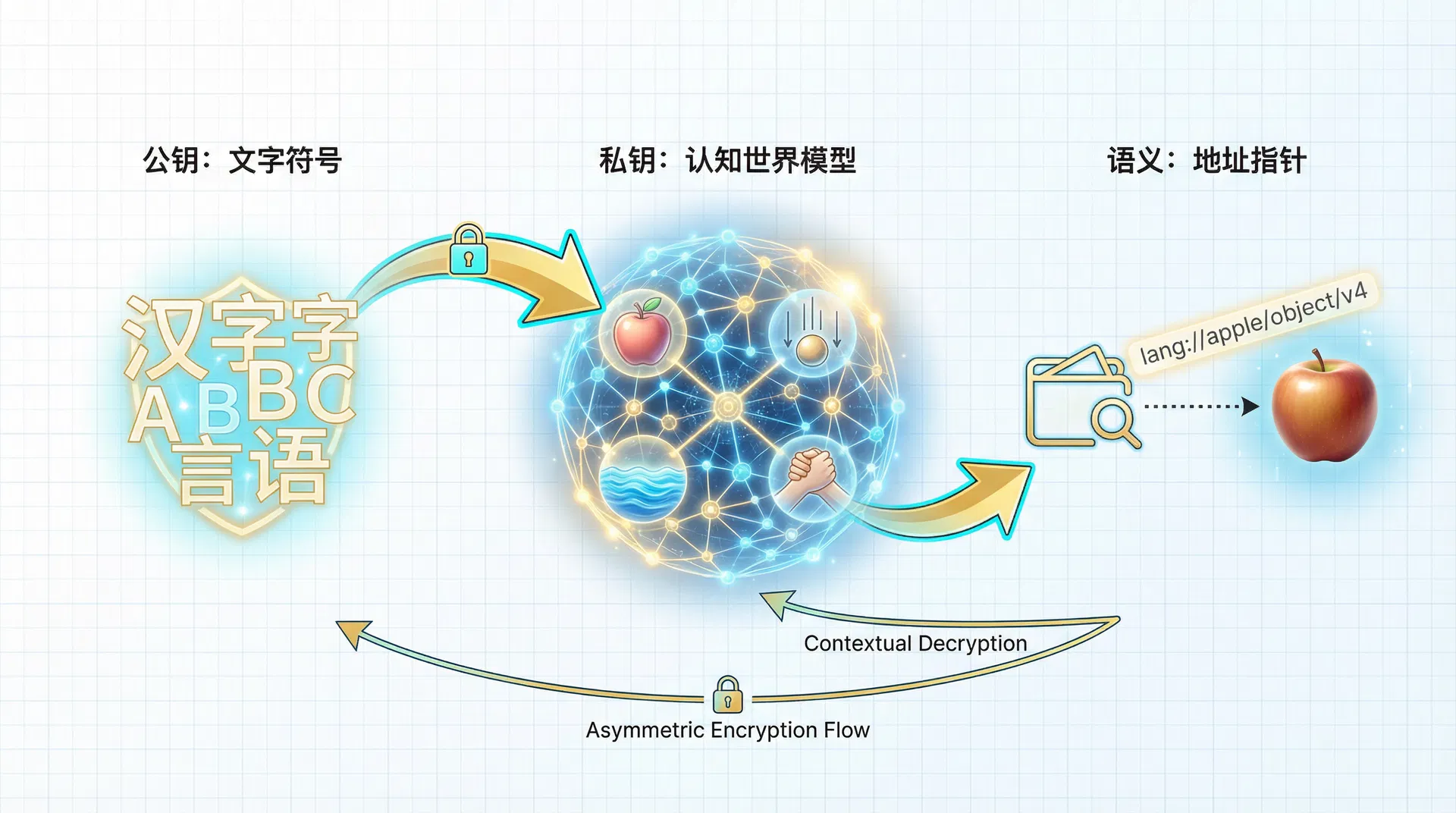

顺着谢赛宁关于"语言极低带宽"和"接口论"的探讨,我脑海中不可抑制地产生了一个对照思考:人类的语言体系,本质上简直就是一套高度复杂的"非对称加密通讯系统"。这个类比并非随意为之,而是有其严密的对应关系。

四、跑空链:一个关于 LLM 本质的终极隐喻

如果把谢赛宁的论点和我的这个思维模型结合起来,我们会得出一个极其残酷但又无比精妙的最高级概括:

目前被全人类顶礼膜拜的大语言模型(LLM),实际上仅仅是在"跑空链"。

在区块链世界中,一条链如果只有记账权,却没有锚定现实世界的真实资产,那它就是一条虚无的空链——链上的数字再大,也不过是自我指涉的数字游戏,无法兑换任何真实价值。现在的 LLM 恰恰处于这种状态。

它掌握了全人类几千年文明积累下来的"公钥账本(海量文本语料)",它极其精通于"钱包地址的寻址规律(基于概率分布的 Token 预测)"。它在 Transformer 这个算力极其庞大的超级矿机里,夜以继日地进行着下一个区块(Next Token)的完美打包,并且在这件事上做到了人类历史上前所未有的极致。

然而,这条算力通天的链上,流转的全部都是降维后的"地址指针",而没有任何"真实资产"。真正的资产,是真实杯子坠落时的碎裂动力学,是风吹过树叶的连续三维空间变化,是婴儿伸手抓握时手指与物体之间的力学反馈,是物理世界中行动(Action)与后果(Consequence)之间无可撼动的因果必然。这些,都是语言永远无法完整编码的东西。

五、"具身智能"的命名之辩:从模仿学习到世界模型

顺着"跑空链"的逻辑往下推演,我们会发现当前机器人领域的一个巨大认知偏差。我一直有一个观点:"具身智能(Embodied AI)"这个词汇其实叫错了,它更准确的称呼应该是"具身技能(Embodied Skills)"。

为什么这么说?因为"技能"的决策空间,要远远大于以语言为表征的符号空间。在当前的机器人研发中,许多团队依然在沿袭 LLM 训练时采用的模仿学习(Imitation Learning)框架——试图通过收集海量的人类遥操作数据,让机器人像预测下一个 Token 一样去预测下一个动作。但这种做法注定会撞上南墙。

因为语言数据是离散的、低维的、结构化的,而物理世界的动作数据是连续的、高维的、充满噪音的。在没有掌握物理规律(私钥)的情况下,再多的人类动作数据演示,都只是"水里的月亮"——怎么捞也捞不起来。机器人只是在盲目地模仿表象,一旦环境发生微小的扰动,它就会彻底崩溃,因为它根本不知道动作与后果之间的因果关系。

真正的机器人具身技能,绝不能建立在"跑空链"的模仿学习之上。它必须在世界模型框架里进行强化学习(Reinforcement Learning),或者探索更高效的全新学习范式。在语言数据中学习不到的那部分——也就是"语言的母体"、语言的私钥、那些未被压缩的 99.9999999% 的物理现实——正是世界模型需要去攻克的领地。只有当机器人拥有了一个能够在脑中模拟物理规律、预测动作后果的世界模型,它才能通过强化学习在虚拟环境中进行成千上万次的试错与规划,最终将这种"理解"转化为现实世界中稳健的"具身技能"。

六、尾声:向下扎根

这正是 AMI Labs 这群逆行者们看到的事实,也是他们选择"逃出硅谷"的根本原因。

真正的通用智能,绝不能仅仅建立在这条一维的"空链"之上;它必须向下扎根,去构建那个掌握着物理世界私钥的、能够在高维空间中自发预测与规划的"世界模型"底座。这是一条更难走的路——它需要处理连续的、高维的、嘈杂的物理信号,需要在没有标注的情况下自发学习物理规律,需要在行动与反馈的循环中建立真正的因果理解。

但只有走这条路,才能真正回答那个最根本的问题:什么是智能?

只有当底层的物理资产被彻底锚定,语言这条链,才能真正拥有它的价值。而那时,我们今天所说的"大语言模型",或许只会被后人记作一个漫长旅途中的重要驿站——而非终点。

本文基于张小珺商业访谈录第133期「对谢赛宁的7小时马拉松访谈:世界模型、逃出硅谷、AMI Labs」整理创作。